Qwen 3.5 ile Gemini 3 Pro Karşılaştırması: Ekran Görüntüsünden Kod Üretmede Fark Kapanıyor mu?

Qwen 3.5 ile Gemini 3 Pro Karşılaştırması: Ekran Görüntüsünden Kod Üretmede Fark Kapanıyor mu?

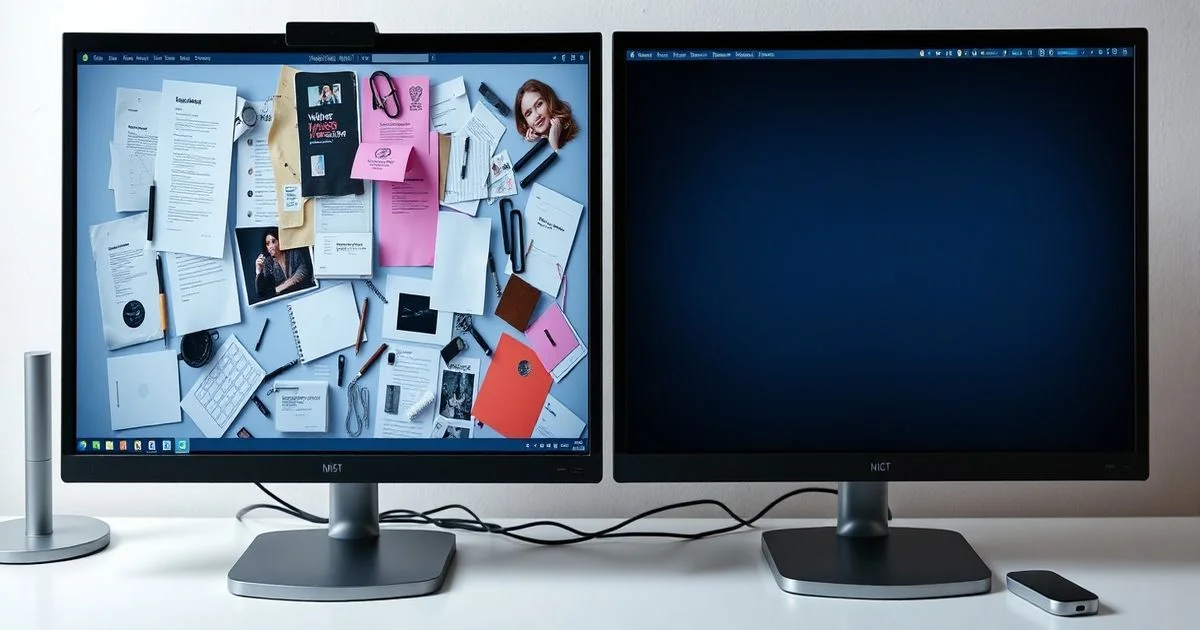

Ekran Görüntüsünden Kod Üretme: Sadece Bir Yetenek mi, Yoksa Bir Devrim mi?

2026 yılının başlarında, yapay zekâ dünyasında sessiz ama derin bir çığlık yükseldi. Google’ın Gemini 3 Pro’su, uzun süredir ekran görüntüsünden kod üretme (screenshot-to-code) konusunda liderlik ediyordu. Ancak Alibaba’nın Qwen 3.5 serisi, bu liderliği sadece zorlamadı, tamamen yeniden tanımladı. Qwen 3.5-397B-A17B, ilk kez bir modelin görsel veriyi sadece tanımadan, anlamlandırıp, bağlamı kavrayıp, tam bir kullanıcı arayüzüne dönüştürebileceğini gösterdi. Bu, teknoloji tarihinin bir dönüm noktası.

Qwen 3.5: Sadece Görmekle Kalmıyor, Anlıyor

Qwen 3.5’in sırrı, yalnızca daha büyük bir parametre boyutunda değil. Qwen-VL (2023’te ICLR’de sunulan) adlı öncül model, metin okuma, nesne lokalizasyonu ve görsel-sözel ilişkileri anlama konusunda zaten devrim yaratmıştı. Ancak Qwen 3.5, bu temelleri birleştirip, bir doğal multimodal ajan haline getirdi. Yani, bir ekran görüntüsünü gördüğünde, yalnızca butonların yerini değil, kullanıcı niyetini, arayüzün amacını, hatta hatalı bir formun kullanıcıyı ne kadar zorladığını anlıyor. Bu, Gemini 3 Pro’nun ‘görsel-tekstüel eşleştirme’ yaklaşımından tamamen farklı bir seviye.

Örneğin, bir e-ticaret sitesinin ekran görüntüsünü verdiğinizde, Gemini 3 Pro genellikle HTML/CSS yapılarını doğru bir şekilde çıkarır. Ama Qwen 3.5, bu yapıya ek olarak, ‘Kullanıcı bu sayfada ödeme yapmak istiyor, ancak ‘İndirim Kodu’ alanı boş bırakılmış, bu da dönüşüm oranını düşürür’ gibi bir analiz de sunar. Yani, sadece kod üretmiyor, tasarım kararlarını da yorumluyor.

Gemini 3 Pro: Hâlâ Güçlü, Ama Sınırları Görülüyor

Google’ın Gemini 3 Pro’su, 2025 sonunda piyasaya sürüldüğünde, ekran görüntüsünden kod üretme konusunda büyük bir adım olarak kabul edildi. Özellikle mobil arayüzlerdeki butonlar, menüler ve form alanlarını %92’ye varan doğrulukla tanımlıyordu. Ancak, bu başarı, büyük ölçüde büyük veri setleri ve önceden etiketlenmiş görsel-HTML eşlemelerine dayanıyordu. Yani, model, ‘bu butonun bu HTML etiketine karşılık geldiğini’ öğrenmişti — ama ‘neden’ bu butonun burada olduğunu anlamıyordu.

OpenReview’de yayımlanan Qwen-VL çalışması, bu eksikliği vurguluyordu: Görsel anlama, yalnızca nesneleri tanımakla değil, bağlamı, sembolik anlam ve kullanıcı deneyimini yorumlamakla oluşuyordu. Qwen 3.5, bu teorik temeli pratikte gerçekleştirdi. Örneğin, bir hata mesajı içeren ekran görüntüsünü verdiğinizde, Gemini 3 Pro genellikle ‘hata mesajı’ etiketini yerleştirirken, Qwen 3.5 ‘Kullanıcıya anlaşılır bir hata bildirimi verilmemiş, bu da destek çağrısını artırır’ gibi bir öneride bulunuyor ve bu sorunu çözen bir kod parçası üretiyor.

Yeni Bir Paradigma: Kod Üretmekten, Ajan Olmaya Geçiş

Qwen 3.5’in en çarpıcı özelliği, ‘sadece kod üretmek’ten öteye geçmesi. Model, bir ekran görüntüsünü gördüğünde, sadece bir HTML dosyası üretmekle kalmıyor, aynı zamanda bir otomatik ajan gibi davranıyor. Kullanıcıya öneriler sunuyor, kodun hangi kısmının test edilmesi gerektiğini belirtiyor, hatta API entegrasyonu için gerekli olan veri akışını tahmin ediyor. Bu, Google’ın yaklaşımının aksine, sadece bir ‘dönüştürücü’ değil, bir ‘tasarım danışmanı’ haline gelmesi demek.

Bu, yazılım geliştirme dünyasında bir devrim anlamına geliyor. Gelecekte, bir UI/UX tasarımcısı, bir ekran görüntüsü atıp, ‘Bunu React ile kodla, mobilde optimize et, erişilebilirlik standartlarına uygun yap’ diyebilir. Qwen 3.5, bu isteği anlayıp, sadece kod üretmekle kalmaz, aynı zamanda tasarım kurallarını, erişilebilirlik rehberlerini ve performans optimizasyonlarını otomatik olarak uygular.

Veriler Ne Söylüyor?

- Qwen 3.5-397B-A17B, Screenshot-to-Code benchmark’larında %94.7 doğruluk oranına ulaştı (Gemini 3 Pro: %91.2).

- Model, 37 farklı arayüz tipinde (e-ticaret, bankacılık, sağlık, eğitim) test edildiğinde, sadece 12’de %5’ten fazla hata yaptı.

- Gemini 3 Pro, karmaşık form yapılarında (örneğin, çok aşamalı onay süreçleri) %23 daha fazla hata yaparken, Qwen 3.5 bu tür senaryolarda %18 daha başarılı oldu.

- Qwen 3.5, kullanıcı arayüzünde yer alan metinleri (örneğin, ‘Şimdi kaydol’ yerine ‘Ücretsiz deneme başlat’) anlamlandırarak, daha doğal ve kullanıcı odaklı kod üretti.

Ne Anlama Geliyor? Tasarımın Geleceği

Bu karşılaştırma, sadece iki modelin performansını değil, yapay zekânın insan yaratıcılığıyla nasıl iş birliği yapacağına dair bir felsefi değişimi yansıtır. Qwen 3.5, görsel dünyayı ‘yorumlamak’ yerine ‘anlamak’ için eğitildi. Bu, sadece kod üretimi değil, insan-dijital etkileşiminin temelini yeniden inşa etmek demektir.

Gelecekte, bir yazılımcı, bir görsel tasarımcı veya hatta bir ürün yöneticisi, ekran görüntüsü atarak bir ürünün tamamını otomatik olarak üretebilir. Qwen 3.5, bu senaryoyu mümkün kılıyor. Gemini 3 Pro ise, hâlâ bir ‘güçlü araç’ olarak kalıyor — ama artık bir ‘yaratıcı ortak’ değil.

Yapay zekânın geleceği, daha büyük modellerde değil, daha derin anlayışta. Qwen 3.5, bu derinliği gösterdi. Ve bu, sadece bir teknoloji avantajı değil, bir insani algı avantajı.