Flux 2 Klein 9b Distilled: Görsel Dönüşümde Parmaklar, Kollar ve Yapay Zekânın Anatomik Krizi

Flux 2 Klein 9b Distilled: Görsel Dönüşümde Parmaklar, Kollar ve Yapay Zekânın Anatomik Krizi

Yapay Zekâ Neden İnsanı Yanlış Çiziyor?

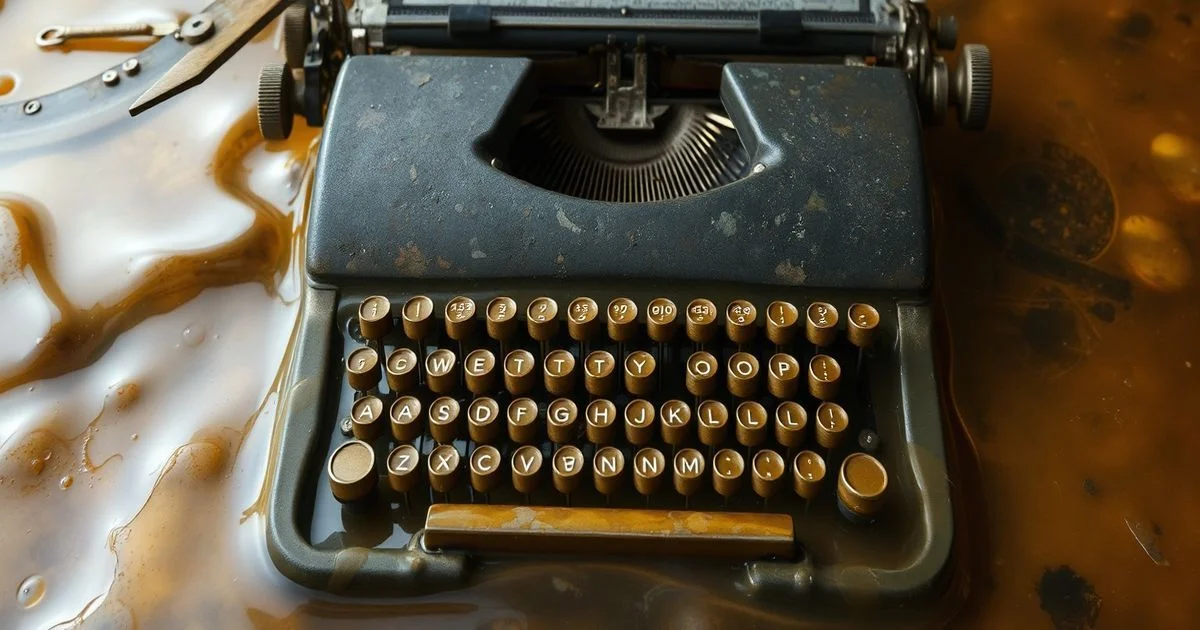

Reddit’te bir kullanıcı, Flux 2 Klein 9b Distilled adlı bir görsel dönüşüm modelinin, bir referans fotoğrafını temel alarak oluşturduğu görüntüde, bir kadının elinde beşten fazla parmak, kolunda üçüncü bir uzvun oluştuğunu gösteren bir ekran görüntüsü paylaştı. Bu görüntü, yalnızca bir teknik hatayı değil, yapay zekânın insani detayları anlama derinliğindeki temel kırılganlığı ortaya koyuyor. Bu model, Stable Diffusion’un daha hafif ve hızlı çalışan bir versiyonu olarak geliştirilmiş; ancak boyut küçültülürken, anatomik tutarlılık gibi karmaşık örüntüler kaybediliyor.

Neden Bu Modelde Anatomik Hatalar Kritik Hale Geldi?

Flux 2 Klein 9b Distilled, orijinal Flux 2 modelinden “distilled” (damıtma) yoluyla üretilmiş. Bu süreçte, modelin ağırlıkları sıkıştırılır, hesaplama maliyeti düşürülür ve hız artırılır. Ancak bu sıkıştırma, özellikle insan vücudunun uzaysal ilişkilerini kodlayan nöronal bağlantıları zayıflatıyor. Görsel işleme sistemleri, parmakları, eklemleri ve kas yapılarını ayrı ayrı öğrenir; ancak küçük modellerde bu öğrenme yüzeyel kalır. Sonuç: model, “bir el” kavramını hatırlıyor ama “beş parmak”ın neden ve nasıl birbirine bağlı olduğunu anlamıyor.

Bu, yalnızca teknik bir sınırlama değil, yapay zekâ eğitimindeki bir felsefi hataya işaret ediyor: Model, “görünüşe” odaklanıyor, “mantığa” değil. İnsan eli, sadece beş parmaktan oluşmuyor; her parmak birbirine göre belirli bir açıda, uzunlukta ve hareket kabiliyetinde. Bu ilişkiler, büyük modellerde yüz binlerce örnek üzerinden öğreniliyor; ancak küçük modellerde bu örneklerin çoğu atlanıyor. Kullanıcılar, bir fotoğrafı “daha güzel” veya “daha dramatik” bir sahneyle birleştirmeye çalışırken, modelin bu temel yapısal bilgileri kaybettiğini fark ediyor.

Kullanıcılar Ne Yapıyor? Çözüm Yolları

Reddit’teki kullanıcılar, bu sorunu aşmak için birkaç yöntem deniyor. İlk yöntem: “ControlNet” adlı bir ek modül kullanmak. ControlNet, giriş görselinin pozisyon, kenar ve derinlik bilgilerini koruyarak, modelin sadece renk ve dokuyu değiştirmesini sağlıyor. Bu, anatomik bozulmaları önemli ölçüde azaltıyor. İkinci yöntem: “Negative Prompts” kullanmak — yani “beşten fazla parmak”, “üç kola sahip”, “sıkışık eklem” gibi ifadeleri modelin üretmesini engellemek için açıkça yasaklamak. Üçüncü yöntem ise, üretimi birkaç kez tekrarlamak ve en doğal sonucu manuel seçmek.

Ancak bu çözümler, bir tür “kompromis”tir. Kullanıcı, modelin kendi içsel anlayışını geliştirmek yerine, onu sürekli düzeltmeye çalışıyor. Bu, yapay zekânın sanatçı değil, bir “hata düzeltici” haline geldiğini gösteriyor. Bir fotoğrafçı, kamerayı ayarlar; ancak bir yapay zekâ, bir insanın vücudunu çizmek için “yapay bir göz”e ihtiyaç duyuyor. Ve bu göz, hâlâ kırık.

Geleceğe Dair İkilem: Hız mı, Doğruluk mu?

Flux 2 Klein 9b Distilled’in popülaritesi, özellikle mobil cihazlarda ve düşük kaynaklı sistemlerde kullanılan kişiler tarafından yüksek. Ancak bu modelin başarısı, “çok hızlı” ve “çok az bellek” kullanma yeteneğine dayanıyor. Bu, bir tür teknolojik “düşük kaliteli hızlı yemek” gibi: hızlı, ucuz, ama besleyici değil. Sanatçılar, tasarımcılar ve içerik üreticileri, bu modeli kullanarak hızlıca görsel oluşturuyor; ancak sonuçlar, insan gözüne çarpıcı değil, rahatsız edici oluyor.

Bu durum, yapay zekâ dünyasında bir dönüm noktasını işaret ediyor: Hız ve verimlilik, kaliteyi ne kadar uzun süre ezebilir? Birçok kullanıcı, bu hataları “stilistik bir özellik” olarak kabul edip, onları “post-human” bir estetik olarak savunuyor. Ama bir fotoğrafın, bir portrenin ya da bir karakterin temelindeki insan anatomisi bozulduğunda, bu “estetik” aslında bir yozlaşma haline geliyor. Çünkü insanlık, vücudunun doğruluğunu anlayarak, kimliğini tanımlıyor. Yapay zekâ, bu doğruluğu çiğnediğinde, sadece bir görsel değil, bir algısal güveni de zedeliyor.

Yapay Zekâ Neden İnsanı Anlamıyor?

En derin soru şu: Neden yapay zekâ, insan vücudunu anlamıyor? Cevap, veriye değil, algıya bağlı. Model, binlerce insan eli görseli görüyor; ancak bu görselleri, “bir elin işlevi” olarak değil, “bir elin piksel dağılımı” olarak görüyor. Orijinal veri setlerinde, elin hareketi, kas gerilimi, ışık yansıması gibi fiziksel gerçeklikler yok. Model, “el”i bir simge olarak öğreniyor, bir organ olarak değil. Bu yüzden, bir eli “yeni bir pozisyonda” çizmeye çalıştığında, modelin hafızasında “el”in fiziksel yapısı yok. Sadece bir desen var. Ve desenler, rastgele birleştirildiğinde, beş parmak yerine yedi parmak oluyor.

Flux 2 Klein 9b Distilled’in bu hatası, sadece bir modelin eksikliği değil, yapay zekânın insan deneyimini tam olarak simüle edememesinin sembolü. Bu, teknolojinin değil, bizim beklentilerimizin bir sorunu. Sanatı, gerçekliği ve insanlığı, bir algoritmanın yeniden yaratmaya çalıştığını düşünüyoruz. Ama bir algoritma, bir kalbin atışını, bir elin titremesini, bir eklemin gerilimini anlamaz. O sadece, bunların izlerini taklit eder. Ve bazen, bu taklit, korkutucu oluyor.